当巨人撞到微缩模型时谁会留下,谁会走?

在当今的人工智能 (AI) 世界中,大型语言模型 (LLM) 就像占据主导地位的巨人。回答问题,甚至编写代码。这些模型也非常出色,但仔细想想,这些巨头需要多少功率和空间呢?这些型号可能用途广泛,但它们很笨重。缓慢而浪费。

如果我们有其他选择呢?一个像新星一样、更敏捷、更经济、也许在某些方面更聪明的替代方案?

那就是小型语言模型 (SLM)。

谁是 SLM?Tiny But Brilliant 存在

SLM 是类似于 LLM 的语言模型,但要小得多。将 LLM 想象成功能强大但体积庞大的超大型计算机。SLM 就像智能手机一样,可能没有那么强大,但它们更加敏捷和便携。这使得它适用于许多应用。在这种情况下,我们不需要那么多的处理能力。

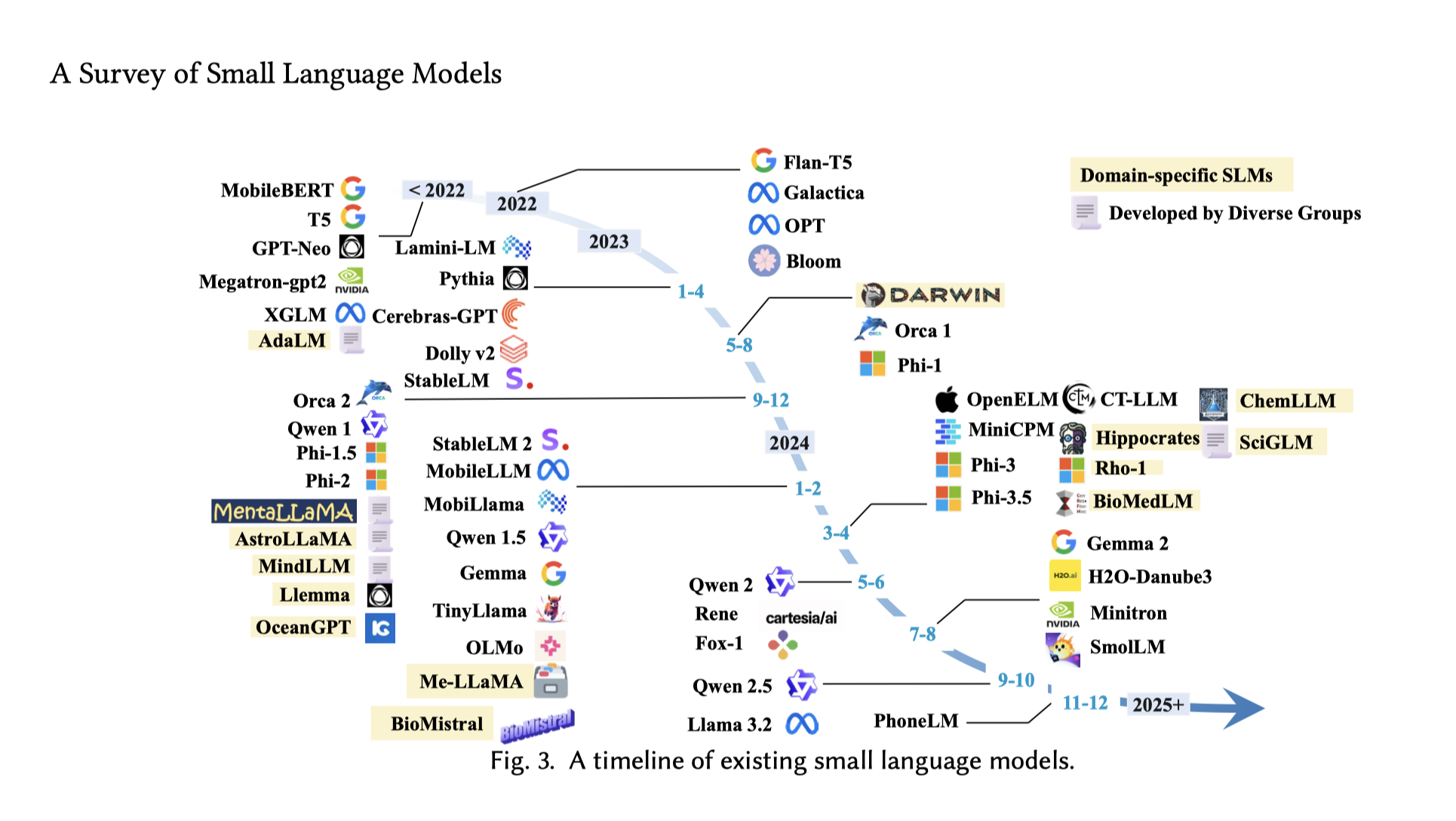

(照片来自论文,参考)

为什么选择 SLM?SLM 成为热门的 5 个原因

为什么 SLM 如此有趣?这些模型有什么好处,让很多人开始关注它们?

- 节能和节省空间: SLM 就像短跑运动员。这些模型可能不是最耐用的,但它们可以在短距离内运行得更快。这些模型消耗的能源更少。与 LLM 相比,它们需要更少的存储空间并且处理速度要快得多,因此非常适合在移动或 IoT 设备等小型设备上使用。

- 更私密、更安全: 想想我们的个人信息。无论是聊天消息,健康数据或财务数据在我们自己的手机上进行处理,不会发送到任何地方。这些模型有助于提高我们的数据安全性和私密性。

- 根据您的喜好进行定制: 像橡皮泥一样的 SLM我们可以将这些模型塑造成我们想要的任何东西。无论是个人助理。无论您是编码人员、编码人员还是主题人员,SLM 都可以比 LLM 更轻松地适应不同的任务。

- 物有所值: 创建和部署 LLM 与构建宇宙飞船相同。它需要大量的金钱和资源,但 SLM 就像制造汽车一样,更便宜、更快、用途更广。这使得 SLM 成为许多组织和开发人员更具成本效益的替代方案。

- 立即回复: 在一个一切都必须快速的世界里,SLM 是英雄。这些型号的响应速度比 LLM 快得多,因此非常适合需要高响应速度的应用。

SLM 与 LLM:擅长不同事情的同事

很多人可能想知道,SLM 和 LLM 有什么区别?这些模型是竞争对手吗?

事实上,SLM 和 LLM 并不是直接竞争对手。这两种类型的模型就像擅长不同事情的同事。

LLM 可能擅长复杂的任务并且需要全面的知识,而 SLM 擅长特定任务并且需要速度。

想象一下: LLM 就像精通各个领域的大学教授。 部分 SLM 就像在各自领域表现出色的专业人士。 我们两者都需要。提供基础知识的讲师和提供深入建议的专家。

SLM 的架构:微小智能的背后

SLM 有多种架构,但大多数都是基于 Transformers,这是 NLP 领域非常流行的架构。

变形金刚:理解语言的机械大脑

Transformer 就像机械大脑,可以帮助模型理解语言的含义。此体系结构具有以下主要组件:

- 自我注意: 一种允许模型查看句子中不同单词之间关系的机制。

- 多头注意: 这就像有多个助手来帮助分析数据。

- 前馈网络: 帮助模型学习复杂数据的部分。

- 位置编码: 句子中单词位置的记忆

- 图层归一化: 它允许模型更快、更稳定地学习。

替代架构:当速度和经济性很重要时

除了 Transformer 之外,还有其他有趣的替代架构,特别是当我们需要快速且资源高效的 SLM 时:

- 曼巴: 基于状态空间模型 (SSM) 的架构,可以有效地处理顺序数据(例如文本)并具有较高的处理速度。

- 海姆巴: 一种混合架构,结合了 Transformer 和 Mamba 的优势。

- xLSTM 的: 该架构基于 LSTM(RNN 的一种形式),并进行了改进,以更高效地处理长序列数据。

练习 SLM 以达到 Excel:必须知道的学科提示

训练 SLM 像训练运动员一样多才多艺,需要天赋、练习和正确的策略。

预培训:打下坚实的基础

预训练是在大型数据集上训练 SLM,以便这些模型学习语言的基础知识。词汇和语法

微调:具体、掌握。

微调是调整预先训练的 SLM 以专注于特定任务的过程,就像训练运动员在特定运动中表现出色一样。

解码策略:创意策略

解码策略是用于从 SLM 生成文本的方法,类似于选择正确的单词来创作歌曲或写诗。

从巨人那里汲取力量:从 LLM 中拉取 SLM

我们可以从 LLM 中“拉”出这些模型,而不是从头开始训练 SLM,就像将知识从高级传授给初级一样。

从 LLM 中提取 SLM 的主要技术包括:

- 修剪: 修剪 LLM 以使其更小、更快

- 知识蒸馏: 从 LLM 到 SLM 的知识转移

- 量化: 降低 LLM 的计算精度,使 SLM 处理速度更快。

重要提示:开发 SLM 的高级技术

使 SLM 更加通用研究人员开发了许多先进的技术:

- 从零开始的小语言模型创新训练方法 :如何从头开始练习专注于架构设计、数据集创建和使用适当优化方法的 SLM。

- 用于增强 SLM 性能的监督微调 (SFT) :使用标记数据自定义 SLM 以提高特定任务的性能。

- 知识蒸馏 (KD) 中的数据质量: 强调知识蒸馏中使用的数据的质量,尤其是从 LLM 生成的数据。

- 提高 SLM 性能的蒸馏技术: 知识蒸馏中的一种独特技术,旨在解决将知识从 LLM 转移到 SLM 时出现的问题。

- 通过量化提高性能 :旨在减少对 SLM 性能影响的量化方法。

- LLM 中有助于 SLM 的技术: 将 LLM 中使用的技术应用于 SLM 以提高效率。

SLM 能做什么?应用范围广

SLM 不仅擅长经济。这些模型还可以执行各种任务:

- 问答 (QA): SLM 可以是智能助手,可以准确快速地回答问题。

- 编码: SLM 可以成为您的编码合作伙伴。代码完成和错误检测

- 推荐系统: SLM 可以改进产品和服务推荐系统,使其更加用户友好。

- Web 搜索:SLM 它可以帮助 Web 搜索更准确并满足用户的需求。

- 移动设备:SLM 它允许我们控制设备。(例如,实时跟踪症状而不将数据发送到云端的健康应用程序)。

SLM 如何在移动设备和边缘设备上工作?需要了解的部署技术

在移动和边缘设备上部署 SLM 并不容易,因为这些设备具有内存和功率限制,但有一些技术可以让我们做到这一点:

- 内存效率优化: 减少 SLM 使用的内存

- 运行效率优化: 提高 SLM 的加工速度

SLM 有哪些类型?深入了解通用和域特定 SLM

SLM 并不是唯一的一个。这些模型分为 2 种主要类型:

- 通用域 SLM: 受过培训的 SLM 在许多领域具有一般知识。

- 特定于域的 SLM: 接受过培训具有特定领域专业知识的 SLM(例如,用于医学的 BioMedLM)

SLM 和 LLM:完美的伴侣

SLM 和 LLM 不是竞争对手,而是相互促进的合作伙伴。

- SLM 帮助 LLM: SLM 可以帮助 LLM 在生成可信文本等方面表现更好。相关数据检索模型调优和性能评估

- LLM 帮助 SLM: LLM 可以为 SLM 提供其他信息,并帮助创建用于训练 SLM 的数据集。

可靠性:SLM 的核心

SLM 必须可靠,尤其是在需要高精度和安全性的情况下部署时。

与 SLM 可靠性相关的关键点包括:

- 鲁棒性

- 隐私

- 可靠性

- 安全

- 公平

结论:SLM可持续和可访问的 AI 的未来

小型语言模型 (SLM) 不仅是一个吸引人的趋势,而且是一股将改变 AI 面貌的新浪潮。

在本文中,我们彻底探讨了 SLM 的世界,从它们的优缺点到开发技术和未来趋势。

我们已经看到,SLM 不仅仅是 LLM 的“小兄弟”,而是隐藏的强者。等待发现和解放

AI 的未来不仅仅取决于构建更大、更强大的模型。相反,它是关于构建更智能、更敏捷、更用户友好的模型,而 SLM 将成为解锁未来的关键。